AIアナウンサーって何で自然に喋れるの? そこには、人間の「泥くさい」仕事があった【PR】

「あらゆる現実をすべて自分のほうへねじ曲げたのだ」――。

一見、誰か横暴な人やわがままな振る舞いをする人のことを第三者が描写したような一文ですが、実はこれ、その言葉としての意味以外にとても重要な別の“意味”をもつ文章なんです。

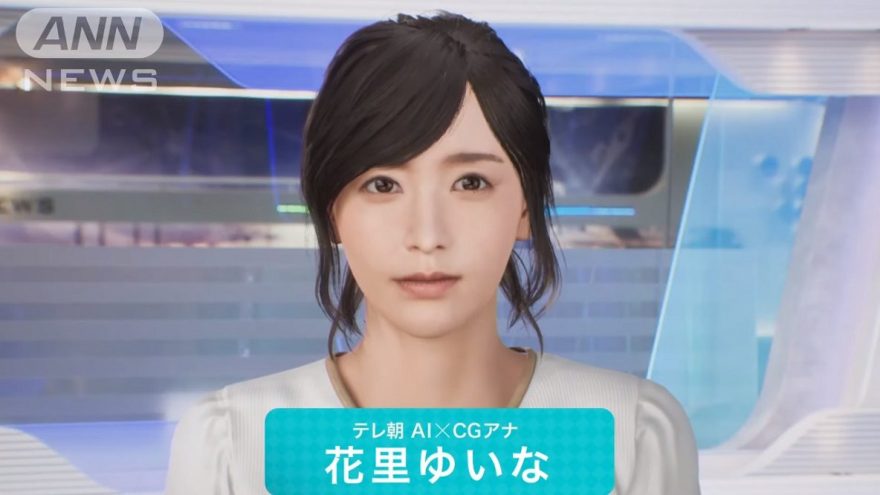

その説明をする前に、ひとりの女性を紹介させてください。

©テレビ朝日

彼女の名前は「花里ゆいな」。職業は、テレビ朝日のアナウンサーです。

“新人”でありながら既にニュースを読んでおり、テレビ朝日系列・ANNニュースのYouTubeチャンネルにも彼女がキャスターとして登場する動画が複数並んでいます。

ただし、お察しの通り、彼女は“人間”ではありません。最先端の技術を駆使して誕生した、“AI×CGアナウンサー”です。

「なんだキャラクターか」「なんだロボットか」と思ってしまう人もいるかもしれませんが、彼女の目の瞬きのタイミングや体の微妙な動きはとても“人間的”。発声される言葉と口の動きも見事にリンクしています。

そして、言葉のイントネーションもかなり自然。「お風呂が沸きました」や「現金をお取りください」といった決まった一言ではなく、長い“1回限り”のニュース原稿がすべて聞き心地の良いイントネーションで入ってきます。

さらに、プロのアナウンサーの証ともいうべき“鼻濁音”まで難なくこなしているのも驚きですね。

また声自体も、従来のCGキャラなどでイメージされるような「機械的な声」とはかけ離れた、トーンから感情まで伝わってくるような、まさに“肉声”というべき声です。

一体なぜ、このような声を発することができるのか? また、声の開発にはどれほどの期間が必要なのか? そして、実際にニュース動画などで声を使う場合、どれくらいの作業を要するのか?

“花里ゆいな”のアナウンサーとしての仕事を可能にしている「音声合成システム」。すなわち、昨今注目を集める「コンピューターで文字を音声にするメディア変換技術」について、気になることを調べてみました。

◆音声研究者の“あるある”

調べるといっても、やっぱ面倒くさいなぁ。それより美味しいものでも食べたいなぁ。ていうか、寝たいなぁ。…などと、あらゆる現実をすべて自分に都合良くねじ曲げたくなったところで、冒頭のお話。

「あらゆる現実をすべて自分のほうへねじ曲げたのだ」――この文章は、日本における音声認識や音声合成の研究開発に広く利用されてきた、母音や子音など様々な音声の前後の組み合わせが考慮された例文集の代表的な一文です。

日本語の音声合成向けに、500以上あるそれら例文がよく録音(収録)されてきたといい、前述の「あらゆる現実を~」はその冒頭一文目ということで、音声研究者で知らぬ人はいない文章なのだそう。

「あらゆる現実をすべて自分のほうへねじ曲げて…カンパイ!」とやるかどうかは分かりませんが、同業者との飲みの席などではしばしば、この「あらゆる現実を~」をはじめとした例文が肴になるといいます。

◆技術発達がもたらした「時短」と「低コスト化」

さて、そんな“職業あるある”を教えてくれたのは、「AI×CGアナウンサー・花里ゆいな」に使われている音声の開発に携わったNTTテクノクロス・メディアイノベーション事業部の中川達也さんと堀内恒さん。

中川達也さん

堀内恒さん

花里ゆいなの声は、同社の音声合成システム「FutureVoice Crayon(フューチャーボイス クレヨン)」で生まれました。

技術が進化し、音声合成システムで幅広い感情なども表現できるようになった現在では、感情やキャラクターを表現し難い「あらゆる現実を~」などの文章を利用するよりも、抑揚感や感情・キャラクターの表現がしやすい、多様な読上げ文が収録で使われるようになったと解説する2人。

では例えば、テレビ朝日の複数の女性アナウンサーの声を合成しつくられているという“花里ゆいな”の声においては、モデルとなるアナウンサーの声の収録時間はどれくらいだったのでしょうか?

答えは、「おひとりにつき2~3時間ほどですね」とのこと。

てっきり何十日何十時間にも及ぶ膨大な音声データの収録が必要なのだろうと考えていたため驚いていると、次のように解説してくれました。

「弊社における“音声合成システム”開発研究の歴史は約50に及びます。NTTですので、最初はもちろん“電話”のための研究でした。

まさに『機械が喋ってる感じだね』という品質から脱却したのが、15年ほど前のこと。いま聴いても人間の声と遜色のない品質ではあるのですが、現在との違いは、かかる時間とコストです。

当時はその品質をつくるために、それこそ声優さんなどに20~30時間ほど10回以上も声を収録してもらって、その後の声の構築作業のコストも数百万~数千万円かかっていました。それが現在のDNN音声合成方式(※1:DNN)では、人の声を再現する“時間”と“コスト”は10分の1かそれ未満になっています。

2~3時間の1回の収録、数十万円~数百万円のコストで感情豊かな肉声感のあるキャラクターをつくることができ、声優やアナウンサーの働き方改革にもつながるので、“それならばやってみよう”と動いてくださる方々から多くオファーをいただいています」

まさに“未来の技術”というイメージの強い、現在の音声合成システム。とてつもない労力と時間、お金がかかるものだと思ってしまいそうなところですが、技術の進化は逆に“時短”や“低コスト化”をもたらしているようです。

※1:DNN(Deep Neural Network)

機械学習の一種であるNeural Networkの階層を深くしたアルゴリズムで、画像認識や音声認識等の分野で活用されている。

◆「非常に泥くさい」仕事

しかし、だからといって仕事自体が「ラクになった」というわけではありません。

収録してから実際にキャラクターなどに運用できるまで音声を構築する作業(=音声合成用モデル構築作業)は、担当する堀内さんいわく「非常に泥くさい」ものであり、最後の出来栄えを左右する所では、人手で作業していくといいます。

音を聴いたり、音の波形を見たりしながら、アクセントや音の境界を振ったりするのですが、特に“語尾”などに表れる話し方のクセを確認しながら作業したりといった工程は、「自動でもある程度できますが、やっぱり人の手が入ることで、キレイに決まっていく」そう。

その構築期間は、収録時間やクライアントのこだわりによって左右されるようですが、2~6週間ほど。複数のアナウンサーの声をミックスした“花里ゆいな”の声は、およそ1カ月で完成したといいます。

◆もたらされる圧倒的な“業務の効率化”

そうして出来上がった“花里ゆいな”の声は、どのように運用され、どのようにニュース動画などに使われていくのでしょうか?

「原稿を打ち込んで読ませるだけなので、パソコンさえあれば、基本的には1人でどこにいても映像用の音声をつくることはできます」

そう話すのは、“花里ゆいな”の動画作成などを行っているテレビ朝日の担当者。

テレビ朝日ではもうひとつ、NTTテクノクロスの音声合成システム「FutureVoice Crayon」を使ったキャラクターとして、“マスクにゃん”というニュース大好きな猫キャラがいます。

©テレビ朝日

YouTubeチャンネルやローカル局の番組などで日々キャスター・MCとして活躍している“マスクにゃん”は、FutureVoice Crayon内に用意された声(※2)を使用しています。

こちらの担当者からも同じような話を聞くことができました。

「ふつうニュース映像をつくる際には、ナレーターさんに録音ブースに入ってもらって音を収録して、その音を持って編集ブースに移動して編集、という流れで作業するので、その工程と比べると驚くほど作業量は減りますね」

また両担当者からは、複数人で同時にキャラクターを使った作業ができることもメリットとして挙げられました。現在、“花里ゆいな”でも“マスクにゃん”でもそうしたことは行われていませんが、動画用の音声を「量産する」のも可能ということになります。

このようなユーザーの感想について、NTTテクノクロスの担当者からも次のような話が聞かれました。

「ニュースだけに限らず、映像制作においては、ナレーターさんや声優さんがつかまらない…というのはよくあることだと思います。そうしたなか、人が特定の場にいなくても、また専門的な人がいなくても、限られた人数で容易に映像用の音声をつくることができる。これは、FutureVoice Crayonがもたらす大きなメリットです。

また、もし間違いがあったとしても、デスクトップ上でその場で直すことができます。そういった点でも、“時短”の効果は大きいでしょう」

※2:「FutureVoice Crayon」では、日本語50パターン以上の豊富な話者・口調が選択可能。老若男女や感情表現も自由自在で、外国語(英語・中国語・韓国語)も選ぶことができる。

◆驚くべきイントネーションの正確さ

“花里ゆいな”と“マスクにゃん”の両担当者から共通して出たもうひとつの驚き。それは、「言葉のイントネーションの正確さ」です。

FutureVoice CrayonのUI(ユーザーインターフェース)には言葉のイントネーションを細かく調整する機能が搭載されていますが、それを使う機会は想定よりも格段に少ないといいます。

「新しく出てきたニュース用語などはどうしても直さないといけないことはありますが、それでもかなり(イントネーションは)正確です。長い原稿でも、手動で直さなければいけない箇所は数か所ほどですね。

運用する前は、もっと直さなければならないだろうなと思っていたので、その処理能力の高さには本当に驚きました。打ち込んだ原稿から音声ができるまでの速度も非常に速いです」

そして、“花里ゆいな”の動画制作の担当者からは、イントネーションの調整機能についてこんなエピソードも。

「以前、関西出身の人間がキャラクターの声の調整をしたことがあったのですが、彼自身は普段は標準語で話す人なんですけど、出来上がった音声を聞いてみたら、微妙に、そしてとても自然に関西弁のイントネーションになっていたんです(笑)」

このエピソードからは逆説的に、運用者の意向に合わせて柔軟にイントネーションを変えられることが分かります。

◆アイデア次第で無限に広がる可能性

また、今回“花里ゆいな”や“マスクにゃん”をはじめ音声合成システムでつくられたキャラクターの声を聞いていて最も驚かされたのが、「多様かつ自在」であることです。

何か文章を打ち込み、それをキャラクターに読んでもらうとき…。

1回目は普通に読まれた文章が、「じゃあ次は明るく読んでもらいましょう」とクリックひとつで簡単に操作され、2回目はまったくトーンの違う聞こえ方になる。

そして、その両方がとても自然であり、「普通」のときはこちらも何も思わず無感情で心地よく聞くことができ、「明るく」のときは聞く側も相手(キャラクター)の“感情”に呼応するように無意識に少し明るい気持ちになる。

そうした驚くべき表現力と自然さを可能にしているのが、抑揚感や感情表現に重きを置いて綿密に計算された声の収録作業と、その後の「非常に泥くさい」構築作業というわけです。

だからこそ、人間が一生懸命に仕事しているからこそ、発せられる音声に不思議な“温かみ”が感じられるのかもしれません。

現在は、ニュースをはじめ情報伝達のツールとして使われることの多い音声合成システムですが、今後より音質や多様性が高まっていくなかで、消費者・ユーザーとのコミュニケーション、またゲームや各種動画配信などエンターテイメントの分野で使われていくことも増えていくことでしょう。

FutureVoice Crayonは、「誰の声でも再現できる」音声合成システム。その活用法は、アイデア次第で無限に広がります。

※製品情報:「FutureVoice Crayon」(NTTテクノクロス株式会社)

多彩なバリエーションと表現を可能にした最先端の音声合成。サンプル音声や、製品のラインナップはこちらからご覧いただけます。

http://www.futurevoice.jp/